時間:2025-03-31 16:14 來源:投資界 閱讀量:10269

“如果人工智能是一塊蛋糕,那么無監(jiān)督學(xué)習(xí)是蛋糕的主體,監(jiān)督學(xué)習(xí)是糖霜,強(qiáng)化學(xué)習(xí)只是頂上的櫻桃。”

強(qiáng)化學(xué)習(xí),重新變得性感了。

就在3月5日,2025年的圖靈獎頒給了強(qiáng)化學(xué)習(xí)的兩位理論奠基者——安德魯·巴托和理查德·薩頓(Richard Sutton)。

這次頒獎,像是一個不斷放大的信號,揭示了一個越來越明確的AI研究范式轉(zhuǎn)折——引入RL,AI研究從“快思考”推進(jìn)到“慢思考”(在推理時深思熟慮)。

在過去這一年間,RL從一度沉淪的位置,重新走回了AI研究的閃光燈中心。2024年下半年,OpenAI率先發(fā)布了它在LLM基礎(chǔ)上,用RL實現(xiàn)“深度思考”的成果——o1,設(shè)定了新的終點線。今年初,DeepSeek將賽道上的迷霧更進(jìn)一步迅速驅(qū)散了,把自己的方案完全開源,在LLM中加入“純RL”,讓R1的推理能力比肩甚至超過o1。關(guān)于RL能幫助通往AGI的共識,迅速凝聚。

一些RL領(lǐng)域的研究者幾乎要喜極而泣了。

AlphaGo曾經(jīng)用驚艷的“神之一手”打敗了人類圍棋的最頂 尖高手李世石,讓世人第 一次大規(guī)模地為AI的智力驚喜以及驚嚇。RL,正是AlphaGo訓(xùn)練的理論基石。

RL的研究者們認(rèn)為,機(jī)器的學(xué)習(xí),可以類比人類,就像多巴胺激勵神經(jīng)元,機(jī)器也能通過與環(huán)境的反饋互動不斷改進(jìn)提升能力。人的時間經(jīng)驗有限,而機(jī)器不受這些限制,在RL中能夠有超人的潛力。

這曾經(jīng)一度是人們對通往AGI的最主流想象。

但在2020年后,更多的人被“LLMs and scaling laws are all you need”吸引走了。大語言模型,以及越來越龐大的預(yù)訓(xùn)練數(shù)據(jù)集,將AI的智能推進(jìn)到了新的階段,也把不走“大力出奇跡”路線的RL相對邊緣化了。

因為LLM能夠?qū)崿F(xiàn)看起來更通用的智能,而RL只能在獎懲明確的特殊環(huán)境中訓(xùn)練出“專科”智能,只能“玩游戲”,而無法處理復(fù)雜的現(xiàn)實環(huán)境。

在一些論壇的AI板塊討論中,從業(yè)者們明確地感覺到,RL的“市場關(guān)注份額”流失,有人抱怨“找不到RL工作”。一些“RL是否走進(jìn)死胡同”的論戰(zhàn)更是非常有意思。RL和LLM的支持者激烈地爭論,誰更好地模仿了人類的自然認(rèn)知模式,誰才更有前途。

直到大語言模型的scaling law開始碰壁,科技樹上的一場新較量開始了。

這正是一部人類智慧交替閃耀的故事。通往AGI的路上,原本是一片黑暗,有人提出用刀耕,有人用火種,有人用哲思,都獲得過成就,也遭遇過瓶頸。而在新的障礙面前,這些方法的新組合,把人類帶到了新的起點。

AlphaGo

2016年3月的首爾,深度學(xué)習(xí)歷史上最 具開創(chuàng)性的時刻之一正在這里發(fā)生。在擊敗歐洲圍棋冠軍Fan Hui后,AlphaGo正式挑戰(zhàn)全球圍棋冠軍李世石。這被全球媒體視為人類智識尊嚴(yán)和人工智能的對決。

結(jié)果足夠驚悚,AlphaGo以4:1的絕 對優(yōu)勢,戰(zhàn)勝了14次圍棋世界冠軍得主李世石。人類轟轟烈烈地落敗了。

在第二局的第37手,AlphaGo出了讓所有人都困惑不已的一招,落在第五線,而非傳統(tǒng)最 優(yōu)選的第三線。解說室懵了,一位評論員稱不知是好是壞,另一位說“這是一個錯誤。”

第37手出現(xiàn)的概率是萬分之一。在AlphaGo的研究員看來,沒有人類會這么下,但這一手仍然是正確的,“它通過內(nèi)省過程發(fā)現(xiàn)了這一點。”同樣在觀戰(zhàn)的Fan Hui評價這是“神之一手”。

AlphaGo戰(zhàn)勝李世石,一下子讓AI在公眾認(rèn)知中爆發(fā)了,AI迎來了前所未有的希望和期待,甚至讓大眾第 一次真正恐懼“AI比人更聰明”。RL的巨大潛力,恐怖如斯。

谷歌的核心高管悉數(shù)到達(dá)首爾,來見證這個“代表谷歌互聯(lián)網(wǎng)業(yè)務(wù)未來”的AI技術(shù)。這場比賽對谷歌非常重要。

谷歌是2010年代那一波歷史性的AI人才爭奪戰(zhàn)的最積極下注方。辛頓僅用4顆GPU和更好的神經(jīng)網(wǎng)絡(luò)算法,就把谷歌用了16000顆CPU的“谷歌貓”踩在腳下,震驚業(yè)界。谷歌毫不吝惜地以4400萬美元拍下辛頓三人的純智力公司,又砸了4億英鎊把英國初創(chuàng)公司DeepMind納入麾下。

DeepMind當(dāng)時展現(xiàn)給谷歌的RL路線,并不是谷歌當(dāng)時的神經(jīng)網(wǎng)絡(luò)做圖像識別、音頻理解等研究方向。但創(chuàng)始人哈薩比斯聚集了當(dāng)時最 好的一批人才,這非常珍貴,哈薩比斯和不少同事都算是辛頓的學(xué)生。更重要的是,哈薩比斯曾用“圍棋”和“打造人腦一樣的通用人工智能”成功說服彼得·蒂爾(Peter Thiel)投了140萬英鎊,也讓谷歌相信了RL讓DeepMind構(gòu)建了一個系統(tǒng),這是在通用人工智能方面的第 一次真正嘗試。

攻克古老的圍棋,是DeepMind向谷歌證明自己的第 一步。哈薩比斯是一個愛玩游戲的學(xué)霸,他研究AI,把兩個愛好完 美結(jié)合,把AI扔進(jìn)游戲里,反復(fù)試錯,直到它玩得比人類更好。

AlphaGo有兩個神經(jīng)網(wǎng)絡(luò),一個負(fù)責(zé)策略,輸出下一步落子的概率;另一個是價值網(wǎng)絡(luò),來輸出落子的勝率。AlphaGo初始學(xué)習(xí)了3000萬步圍棋專家的下法,然后一場接一場地與自己對抗,分析哪些下法是更有利的,飛速進(jìn)步。

在后續(xù)的版本AlphaGo Zero中,DeepMind把RL進(jìn)一步做到極 致——不再提供海量對弈棋局的初始數(shù)據(jù),僅告知基本規(guī)則,由它自我對弈數(shù)百萬次,發(fā)現(xiàn)獲勝策略。AlphaGo Zero經(jīng)過3天的訓(xùn)練,就獲得了比擊敗李世石的版本更強(qiáng)的能力,與后者對弈的勝率是100比0。

而AlphaGo Zero遠(yuǎn)比AlphaGo強(qiáng)大的原因,正在于RL占比提高了。取名為Zero,也暗示了它是真正從零做起,完全自學(xué)成才。

一時間,DeepMind的論文《Mastering the game of go without human knowledge》火得發(fā)燙。該論文稱,即便是在最 具挑戰(zhàn)性的領(lǐng)域中,單純使用RL的方法也是完全可行的:沒有人類實例或指導(dǎo),沒有基本規(guī)則之外的知識,訓(xùn)練達(dá)到超人的性能是完全可能的。

AlphaGo Zero更加簡潔優(yōu)美。AlphaGo的初始版本需要176個GPU和1202個CPU,AlphaGo Zero只需要一臺機(jī)器和4個TPU。

AlphaGo Zero將RL的路線帶到業(yè)界熱情的頂峰。在2018年12月,AlphaGo Zero登上了《科學(xué)》雜志封面。《科學(xué)》雜志給出了這樣一句評價,“能夠解決多個復(fù)雜問題的單一算法,是創(chuàng)建通用機(jī)器學(xué)習(xí)系統(tǒng),解決實際問題的重要一步。”

DeepMind商業(yè)計劃書的第 一行,就是通用人工智能。當(dāng)時的巨大成功,讓哈薩比斯更加確認(rèn)了DeepMind的使命,“這是我們開發(fā)通用算法的一大進(jìn)步”。

DeepMind繼續(xù)研究如何把提升AlphaGo,把它的能力遷移到其他領(lǐng)域。AlphaGo Zero更加通用,除了圍棋還輕松地在國際象棋、日本將棋領(lǐng)域達(dá)到頂 尖水平。AlphaFold在預(yù)測蛋白質(zhì)結(jié)構(gòu)上成就斐然,哈薩比斯還因此獲得了諾貝爾化學(xué)獎。AlphaStar能玩《星際爭霸II》。

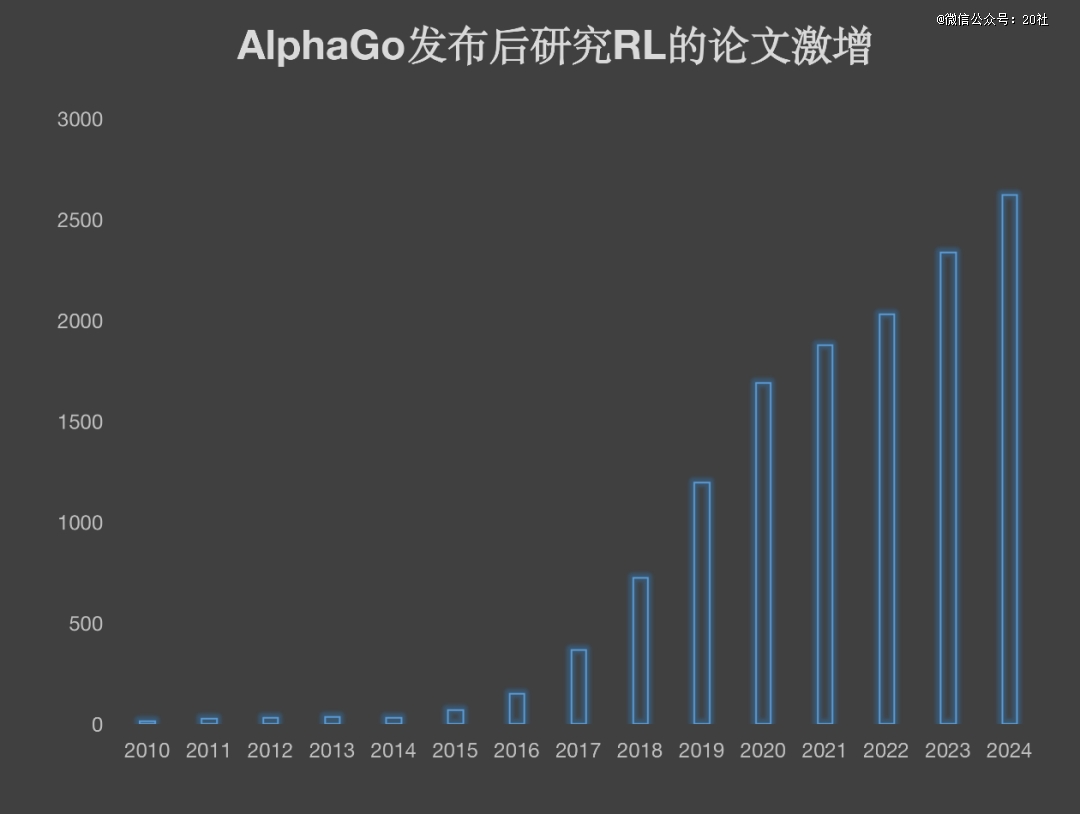

業(yè)界對這一探索方向也懷抱著巨大的希望。RL相關(guān)論文激增。在機(jī)器人、自動駕駛、儲能等行業(yè),RL是一種非常合適的訓(xùn)練學(xué)習(xí)路徑,行業(yè)研究也越來越深入。

僅統(tǒng)計arXiv,制圖:20社

“死胡同”

辛頓對哈薩比斯個人的聰明程度評價甚高,稱“他的實力不僅在智力上,還展現(xiàn)在他對勝利極端且堅定不移的渴望上”。辛頓曾經(jīng)在英國當(dāng)過哈薩比斯短暫的導(dǎo)師,在2014年谷歌收購DeepMind時還專門克服了腰椎間盤病痛無法乘民航飛機(jī)的困難,到倫敦提供了關(guān)鍵的科學(xué)顧問。

但這位連接主義的大拿,對哈薩比斯認(rèn)定的RL路線并不認(rèn)可。

2018年,辛頓和楊樂昆、約書亞·本吉奧(Yoshua Bengio)憑神經(jīng)網(wǎng)絡(luò)深度學(xué)習(xí)獲得圖靈獎。在獲獎后演講中,辛頓開玩笑地要把RL排除在機(jī)器學(xué)習(xí)方法之外,因為“被稱為強(qiáng)化學(xué)習(xí)的第三種方法不太有效。”RL需要太多的數(shù)據(jù)和太多的處理能力,才能完成真實世界中的實際任務(wù)。

要理解他們之間的分歧,我們需要了解一些背景框架。

在AI的漫長探索中,研究者們都在試圖用人類認(rèn)知世界的方式,去建構(gòu)機(jī)器智能的框架(模仿)。因此AI的理論演進(jìn),一直是和人類心理學(xué)、腦科學(xué)、神經(jīng)科學(xué)、哲學(xué)和語言學(xué)的發(fā)展互相糾葛。對本質(zhì)的不同認(rèn)知,也讓AI研究者分化為主要的三大流派。

符號主義認(rèn)為,人的認(rèn)知單元是符號,主張通過公理邏輯和符號操作來模擬人類的智能。一度是最 先獲得實踐應(yīng)用、最風(fēng)靡的流派。IBM的“深藍(lán)”打敗了國際象棋世界冠軍,本質(zhì)上是符號主義的成果。

行為主義關(guān)注行為和刺激之間的關(guān)系,讓機(jī)器通過與環(huán)境交互來學(xué)習(xí)和改進(jìn)其行為。這也就是RL所屬的流派。

事實上,RL的發(fā)展歷程非常曲折,經(jīng)歷了多次長久的寒冬和等待。

最早在在1950年,艾倫·圖靈提出了RL初步的設(shè)想,一種基于獎勵和懲罰的機(jī)器學(xué)習(xí)方法。

在這個想法的基礎(chǔ)上,幾十年后的1980年代,AI的寒冬中,巴托與薩頓在麻省理工默默搭建了RL的理論框架和算法體系。他們最核心的貢獻(xiàn)莫過于時間差分學(xué)習(xí)算法,它解決了獎勵預(yù)測的問題,agent如何獲得長期收益。

又過了40年,巴托與薩頓憑借對強(qiáng)化學(xué)習(xí)的研究,獲得了圖靈獎的遲到獎勵。

RL的進(jìn)展受制于算法、算力、數(shù)據(jù)三大瓶頸。DeepMind能夠用RL創(chuàng)造出震驚世界的AlphaGo,有一個重要原因是,它把辛頓等連接主義學(xué)者的成果“神經(jīng)網(wǎng)絡(luò)”借過來了。AlphaGo由兩個13層的深度神經(jīng)網(wǎng)絡(luò)構(gòu)成。

神經(jīng)網(wǎng)絡(luò)和泛化能力的引入,從根本上改變了RL。傳統(tǒng)的RL,依賴于表格的方法和動態(tài)編程,通常需要窮舉所有可能的狀態(tài)和動作組合,計算上難以實現(xiàn)。而神經(jīng)網(wǎng)絡(luò)可以學(xué)習(xí)數(shù)據(jù)中的模式和特征,對新的狀態(tài)進(jìn)行有效的預(yù)測。因此DeepMind后來也把自己的研究稱為“深度強(qiáng)化學(xué)習(xí)”。

第4代的AlphaMuZero可以自己學(xué)會玩圍棋、國際象棋、日本將棋和Atari游戲,還被用來幫YouTube尋找視頻壓縮的更優(yōu)算法。比前幾代更“通用”了,更夠應(yīng)對更多不確定環(huán)境。

但是經(jīng)過神經(jīng)網(wǎng)絡(luò)加強(qiáng)過后的RL,依然是RL。Mu的應(yīng)用還是在有限的游戲環(huán)境中。

AGI需要AI能應(yīng)對不同的任務(wù),而不是只在單一任務(wù)中做到極 致。

在2021年,AlphaGo系列的負(fù)責(zé)人David Silver和RL奠基人薩頓聯(lián)手發(fā)了另一篇文章,《Reward is Enough》,跟神經(jīng)網(wǎng)絡(luò)領(lǐng)域的劃時代論文《Attention is all you need》有異曲同工的修辭。

Silver等人認(rèn)為,一個簡單而強(qiáng)大的原則“獎勵最 大化”下,具備出色智能的agent能夠“適者生存”,習(xí)得知識、學(xué)習(xí)、感知、社交智能、語言、泛化能力和模仿能力。簡而言之,RL將促進(jìn)AGI的實現(xiàn)。這像是把自然界的進(jìn)化論,搬到了AI領(lǐng)域。

但這一理論遭遇了業(yè)界很多的質(zhì)疑和批評,因為它某種程度上非常“空洞”,且論文中提到的泛化,仍難以在實踐中獲得突破進(jìn)展。

強(qiáng)化學(xué)習(xí)是死胡同之類的討論在AI社區(qū)越來越頻繁。圍棋等游戲天然適合RL。但在開放性環(huán)境中,獎勵目標(biāo)或環(huán)境的細(xì)微變化,就會導(dǎo)致整個系統(tǒng)徹底失敗,或者需要重新訓(xùn)練。監(jiān)督學(xué)習(xí)效果是穩(wěn)定的,但RL根本不穩(wěn)定。人類設(shè)定的獎勵,經(jīng)過RL的黑盒子,可能會導(dǎo)向無法預(yù)知的離譜行為。

去年從DeepMind離職創(chuàng)業(yè)的科學(xué)家Misha Laskin認(rèn)為,RL進(jìn)展停留在了超人類、但極度狹窄的智能體層面,缺乏明確路徑來拓展通用性。“如果單一任務(wù)上都要實現(xiàn)六億步的訓(xùn)練,又從哪獲取足夠數(shù)據(jù)來覆蓋所有任務(wù)呢?”

Google DeepMind的研究員Kimi Kong最近在真格基金播客中稱,在2019年之后,RL在算法層面就沒有更多的長足進(jìn)步了。

這種迷茫和低落實際上蔓延在整個RL社區(qū)。尤其在ChatGPT發(fā)布后,LLM展現(xiàn)出來的泛化能力,讓RL開始失去資本和產(chǎn)業(yè)的聚光燈,甚至在一些人看來,是被趕回了象牙塔。

蛋糕上的櫻桃

大語言模型如日中天,但它的頭頂也飄著幾朵烏云。

在2024年底的AI峰會NeurIPS上,OpenAI聯(lián)合創(chuàng)始人兼前首席科學(xué)家Ilya Sutskever宣稱,預(yù)訓(xùn)練時代即將終結(jié),這將已經(jīng)籠罩在行業(yè)頭頂?shù)膕caling law碰壁焦慮徹底一語道破。

AI的訓(xùn)練數(shù)據(jù),正在枯竭。而擴(kuò)大訓(xùn)練數(shù)據(jù)量級提升智能的邊際效應(yīng)也在遞減。

此外,LLM天生不擅長數(shù)學(xué)和物理。因為LLM本質(zhì)上仍是基于語言模式,而科學(xué)原理和人類的決策從根本上講是抽象的,超越了語言或像素的表達(dá)范疇。

怎么辦呢?

OpenAI率先給出了方案。去年年中發(fā)布的o1模型,不是一味擴(kuò)大預(yù)訓(xùn)練規(guī)模,而是用RL結(jié)合CoT技術(shù),實現(xiàn)了深度推理,將大模型的智能又推上一個新的臺階。一個新的范式也出現(xiàn)了,AI研究開始從“快思考”(快速給出預(yù)訓(xùn)練的答案)遷移到“慢思考”(深思熟慮地推理)。

RL的優(yōu)點在此時盡顯優(yōu)勢。其一,RL需要的數(shù)據(jù)量遠(yuǎn)小于LLM。其二,RL善于在環(huán)境中自主探索、動態(tài)學(xué)習(xí)、連續(xù)決策。

據(jù)RL研究者、Pokee AI的創(chuàng)始人Zheqing Zhu的演講,從90年代以來,RL領(lǐng)域一個趨勢是“反向的scaling law”。AlphaGo需要3000萬對局,到AlphaGo Zero,再到MuZero,對局減少到500萬以下,效率呈指數(shù)級提高。

在o1發(fā)布的一個月前,DeepMind的論文《Scaling LLM Test-Time Compute Optimally can be More Effective than Scaling Model Parameters》與o1模型原理幾乎一致,提出增加測試時計算比擴(kuò)展模型參數(shù)更有效。

谷歌在2024年初發(fā)布的《Chain of Thought Empowers Transformers to Solve Inherently Serial Problems》也提出類似觀點,傳統(tǒng)Transformer模型擅長并行計算,用CoT突破其串行邏輯推理的限制。

但為什么不是谷歌摘得果實呢?這又是另一個問題了,或許涉及到大廠的工作考核、組織模式、業(yè)務(wù)牽制等等。谷歌的員工大概率也為此忿懣。

去年兩位DeepMind核心研究員Misha Laskin和Ioannis Antonoglou為了更快地追趕AGI的時間窗口,離職創(chuàng)辦Reflection AI,創(chuàng)業(yè)方向正是基于RL+LLMs的通用Agent。

顯而易見,整個大模型業(yè)界都進(jìn)入了新的心照不宣硝煙四起的競賽中。終點大家都看到了,但后來者誰能率先到達(dá)?

答案是,來自純中國本土團(tuán)隊的DeepSeek。

這里就不再贅述DeepSeek在其他方面的創(chuàng)新,只看它如何實現(xiàn)“深度思考”。

此前OpenAI雖然展示了o1的推理能力,但有意把推理的詳細(xì)過程隱藏掉了,以防止其他模型復(fù)制它的數(shù)據(jù)。因此深度思考能力仍是一個黑盒,其他團(tuán)隊也只能從頭研究。破解的難點除了數(shù)據(jù)、基礎(chǔ)模型,更在于RL環(huán)境通常不完 美,且難以準(zhǔn)確指定獎勵函數(shù)。如果獎勵機(jī)制有噪聲,就很容易被reward hacking,能力卻沒能真正提升。

就像LLM們此前在做RLHF時,這種現(xiàn)象普遍存在,甚至出現(xiàn)越訓(xùn)練模型越笨的情況。

RLHF依靠人類的反饋,并不是一個明確的簡潔的規(guī)則。且RLHF很多部分,是為了實現(xiàn)alignment,為了更像人,而不是更智能。這正是這個原因,OpenAI聯(lián)合創(chuàng)始人Andrej Karpathy認(rèn)為,RLHF并不是真正的RL,只是人類偏好的代理,而非真正的獎勵函數(shù)。

DeepSeek-R1-Zero把黑盒的秘密大張旗鼓地公布給了所有人。它提出了一種完全跳過人類監(jiān)督微調(diào)的模型,純粹通過RL獲得有效學(xué)習(xí)和泛化的能力。它的獎勵函數(shù)簡單到不可思議,只包括兩部分,針對數(shù)學(xué)問題的“準(zhǔn)確性獎勵”和規(guī)定思考過程要置于 '' 和 '' 標(biāo)簽之間的“格式獎勵”。

這種極簡的獎勵機(jī)制,回過頭來看,像極了AlphaGo。而幾年前被指“空洞”的“Reward is Enough”觀點,似乎也得到了一些驗證:DeepSeek創(chuàng)造了適合的策略,找到了適合的獎勵函數(shù),于是R1-Zero獲得理性思考的能力,“頓悟時刻”降臨了。

隨著擁有通用知識的LLM,插上了擅長抽象邏輯、自主推理決策的RL翅膀,兩者互補(bǔ),AI的智能程度顯著提高。這簡直是目前為止完 美的解決方案。

還記得楊樂昆在2016年提出的那個非常著名的蛋糕梗嗎?“如果智能是一塊蛋糕,那么無監(jiān)督學(xué)習(xí)是蛋糕的主體,監(jiān)督學(xué)習(xí)是糖霜,強(qiáng)化學(xué)習(xí)只是頂上的櫻桃。”

他本意是強(qiáng)調(diào)無監(jiān)督學(xué)習(xí)的重要性,從可用的任意信息預(yù)測過去、現(xiàn)在或未來的情況,順便諷刺一下RL。這也是連接主義的學(xué)者嘲笑RL的習(xí)慣性動作。

被刺激到的DeepMind的研究人員,曾經(jīng)還回敬他了一張綴滿櫻桃的蛋糕圖。

不過,這個諷刺意味的meme,反而成了當(dāng)下情形的正面預(yù)言。

OpenAI Deep Research的研究員Josh Tobin很好地描述了這個趨勢:我們2015年、2016年搞RL研究時進(jìn)展受限,是在沒有“蛋糕”的情況下加“櫻桃”。但現(xiàn)在我們有了在大量數(shù)據(jù)上預(yù)訓(xùn)練的強(qiáng)大語言模型,RL終于迎來了合適的發(fā)展時機(jī),AGI Agent和復(fù)雜決策也更加高效和可行。

奧特曼稱未來發(fā)布的GPT-5,將是兩條線合并起來的“神奇的統(tǒng)一智能”,將根據(jù)任務(wù)自行決定是快速回答,還是進(jìn)行深入分析思考。

就像Ilya Sutskever曾提出的比喻,大多數(shù)哺乳動物的大腦體重比遵循一定規(guī)律,但人進(jìn)化出了新路徑,大腦比重更大。AI也會找到突破預(yù)訓(xùn)練模式的新方向。

根據(jù)DeepSeek的預(yù)告,RL提升大模型智能的潛力顯然遠(yuǎn)未窮盡。下一波AI突破才剛剛開始。

聲明:免責(zé)聲明:此文內(nèi)容為本網(wǎng)站轉(zhuǎn)載企業(yè)宣傳資訊,僅代表作者個人觀點,與本網(wǎng)無關(guān)。僅供讀者參考,并請自行核實相關(guān)內(nèi)容。